Em qual arquitetura de rede neural O algoritmo de retropropagação de erros backpropagation é utilizado para treinamento?

Índice

- Em qual arquitetura de rede neural O algoritmo de retropropagação de erros backpropagation é utilizado para treinamento?

- Qual é a limitação das redes perceptron?

- Como válido uma rede neural?

- O que é redes multilayer Perceptrons?

- Como o erro é propagado na fase Backward?

- Que tipo de problema o perceptron resolve?

- Porque em uma MLP não é recomendado um grande número de camadas?

- Quais são as limitações de uma rede neural perceptron simples?

- Qual é a estrutura padrão de uma rede neural?

- Como treinar uma rede neural?

- Qual o parâmetro de aprendizado da rede neural?

- Quando surgiram as primeiras informações sobre neurocomputação?

- Quais são as vantagens das redes neurais artificiais?

- Como a rede neural se relaciona com o ambiente?

Em qual arquitetura de rede neural O algoritmo de retropropagação de erros backpropagation é utilizado para treinamento?

O algoritmo de retropropagação de erro, é um algoritmo utilizado no treinamento de redes neurais multicamadas, e consiste em dois passos de computação: o processamento direto e o processamento reverso.

Qual é a limitação das redes perceptron?

Perceptron Multi-Camadas (MLP) Tal restrição implica que padrões de entrada similares resultem em padrões de saída similares, o que leva o sistema à incapacidade de aprender importantes mapeamentos. ... A camada de saída recebe os estímulos da camada intermediária e constrói o padrão que será a resposta.

Como válido uma rede neural?

Um dos principais pontos na construção de uma rede neural é a escolha correta do algoritmo de treinamento para a rede convergir corretamente, produzir bons resultados e solucionar corretamente o problema abordado. Cada algoritmo de treinamento contém seus prós e contras que devem ser levados em consideração.

O que é redes multilayer Perceptrons?

Perceptron Multicamadas (PMC ou MLP — Multi Layer Perceptron) é uma rede neural com uma ou mais camadas ocultas com um número indeterminado de neurônios. A camada oculta possui esse nome porque não é possível prever a saída desejada nas camadas intermediárias.

Como o erro é propagado na fase Backward?

O algoritmo Back Propagation tem portanto duas fases, para cada padrão apresentado: – Feed-Forward as entradas se propagam pela rede, da camada de entrada até a camada de saída. – Feed-Backward os erros se propagam na direção contrária ao fluxo de dados, indo da camada de saída até a primeira camada escondida.

Que tipo de problema o perceptron resolve?

Um único Perceptron consegue resolver somente funções linearmente separáveis. Em funções não linearmente separáveis, o Perceptron não consegue gerar um hiperplano, esta linha nos gráficos abaixo, para separar os dados.

Porque em uma MLP não é recomendado um grande número de camadas?

A utilização de um grande nú mero de camadas escondidas não é recomendado. Cada vez que o erro médio durante o treinamento é utilizado para atualizar os pesos das sinapses da camada imediatamente anterior, ele se torna menos ú til ou preciso.

Quais são as limitações de uma rede neural perceptron simples?

Os principais problemas das arquiteturas MLP que serão abordados são a sensibilidade a mínimos locais, o não conhecimento a priori da arquitetura ótima de rede e a implementação destes modelos em paralelo.

Qual é a estrutura padrão de uma rede neural?

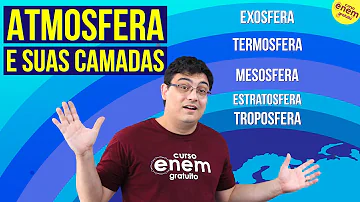

Uma rede neural simples inclui uma camada de entrada, outra de saída (ou alvo) e, entre elas, uma camada oculta. As camadas são conectadas através de nós e essas conexões formam uma "rede" – a rede neural – de nós interconectados. Um nó é modelado conforme o comportamento de um neurônio humano.

Como treinar uma rede neural?

Treinar a rede neural requer os seguintes passos:

- Alimente com os dados de treinamento, o modelo. ...

- O modelo aprende como associar as imagens as labels.

- Perguntamos ao modelo para fazer previsões sobre o conjunto de teste — nesse exemplo, o array test_images .

Qual o parâmetro de aprendizado da rede neural?

- O parâmetro η representa a taxa de aprendizado da rede neural, controlando a tamanho do passo que tomamos na correção do peso.

Quando surgiram as primeiras informações sobre neurocomputação?

- As primeiras informações sobre neurocomputação surgiram em 1943, em artigos do neuroanatomista e psiquiatra Warren McCulloch, do Instituto Tecnológico de Massachusetts, e do matemático Walter Pitts, da Universidade de Illinois.

Quais são as vantagens das redes neurais artificiais?

- As redes neurais artificiais (RNA) têm muitas vantagens, porque se baseiam na estrutura do sistema nervoso humano, principalmente o cérebro. Sua Aprendizagem: as RNAs têm a capacidade de aprender através de uma fase chamada fase de aprendizagem.

Como a rede neural se relaciona com o ambiente?

- Outro fator importante é a maneira pela qual uma rede neural se relaciona com o ambiente. Nesse contexto existem os seguintes paradigmas de aprendizagem: